关于robots的写法网上有很多的介绍,Robots可以用来防止搜索引擎抓取那些我们不想被搜索引擎索引的内容,很多网站都在里面加入网站的地图sitemap.xml,这样可以让蜘蛛快速的爬行网站。

格式:

User-agent: *

Disallow:

Sitemap:sitemap.xml

我们来看看一些大型网站的robots.txt是怎么样写的!

淘宝的robots.txt,屏蔽了百度蜘蛛

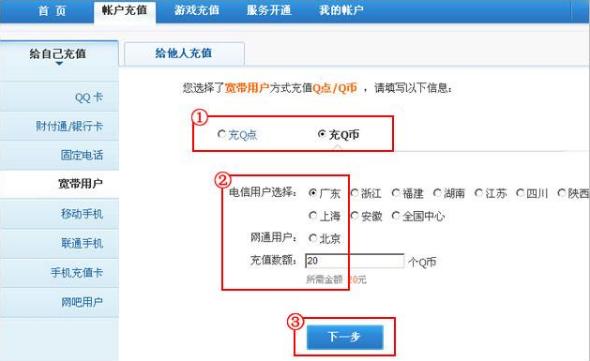

QQ在robots中加入了sitemap

打开qq的sitemap之后发现,存在这样的压缩包,下载回来打开里面放的是sitemap,难道蜘蛛可以分析压缩包了?像我还是头一次见到这样的写法。

CCTV也同样是这样的写法

在robots.txt中加入sitemap这样做到底能不能增加收录,站长朋友们不妨试试!最后感谢瓜视云点播www.tvgua.com站长提供配图!

亲爱的:被墙域名跳转TG:@qianhenetwork QQ:851617266,可否收藏+评论+分享呢?

文章评论 本文章有个评论